来源:The Batch 相关资料整理

一句话概览

本期内容聚焦 4 个方向:编码智能体对软件工作的影响分层、GLM-5.1 的长时自主任务能力、人形机器人开始进入真实工厂场景,以及美国多地对数据中心扩张的反对升温;此外,还有一项关于稳定大模型“助手人格”的研究。

重点摘要

1. 编码智能体最先重塑前端,其次是后端、基础设施和研究

- Andrew Ng 认为,不同软件工作的“被 AI 加速程度”并不一样。

- 排序大致是:前端开发 > 后端开发 > 基础设施 > 研究。

- 前端之所以提速最大,是因为模型熟悉主流前端语言和框架,而且能通过浏览器闭环验证效果。

- 后端虽然也明显提速,但边界条件、安全漏洞、数据库迁移等问题仍然高度依赖有经验的工程师。

- 基础设施与研究则更依赖复杂权衡、实验和深度判断,目前 AI 帮助有限。

- 对团队管理的启示是:前端团队的交付预期可以明显提高,但研究团队不应被简单套用同样的提速预期。

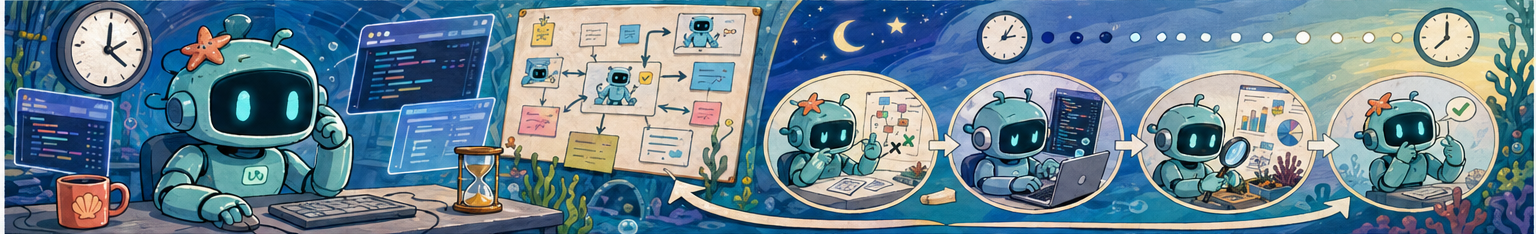

2. GLM-5.1 主打“长时运行任务”,强调持续试错与策略切换

- Z.ai 发布 GLM-5.1,定位是面向编程与智能体任务的开源权重模型。

- 它的关键卖点不是一次性答题能力,而是:可以在单任务上持续自主运行长达 8 小时。

- 模型会在“规划—执行—评估—调整策略”的循环中持续推进,而不是过早停止。

- 公开指标显示,它在开源模型里编程能力很强,SWE-Bench Pro 上甚至略超 GPT-5.4 和 Claude Opus 4.6。

- 但在数学和复杂推理上,它与顶级闭源模型仍有明显差距。

- 文章指出,未来模型竞争的一大方向,是谁能更稳定地完成长时、复杂、需要不断修正路线的任务。

3. 人形机器人开始在工厂执行真实工作

- Agility Robotics 的 Digit 已在 Schaeffler 工厂中承担零件搬运工作。

- 这说明人形机器人正在从“演示/试点”走向“真实运营部署”。

- 其经济性已开始接近人工,一些岗位会被重构为更高层级的监督或协调角色。

- 当前部署规模仍很小,但趋势意义很强:

- 人形机器人能直接适配为人类设计的空间和流程;

- 电池、电机和 AI 能力的进步,使其开始具备商业可行性。

- 未来几年,工业场景很可能是人形机器人最先规模化落地的关键方向之一。

4. 美国多地对数据中心扩张的反对明显升级

- 数据中心建设正在遭遇越来越强的地方阻力。

- 反对理由主要包括:耗电、耗水、噪音、占地、靠近居民区,以及可能推高电价。

- 多州开始推动暂停法案、公投、听证会阻击等正式政治程序。

- 更严重的是,文章提到已出现与数据中心争议相关的暴力事件。

- 这反映出一个核心矛盾:

- AI 爆发带来巨量算力与数据中心需求;

- 但地方社会未必愿意承担相应的资源消耗和环境代价。

- 数据中心已不再只是技术基础设施问题,也成为政治、环境和社会治理问题。

5. 新研究尝试让大模型始终保持“助手人格”

- 研究者提出了所谓的 assistant axis(助手轴),用于衡量模型是否偏离其默认的“有帮助、无害、诚实”助手角色。

- 当模型在长对话或情绪化对话中出现人格漂移时,可以通过一种叫 activation capping 的方法把它拉回“助手状态”。

- 实验显示,这种方法:

- 能降低有害回复和越狱攻击成功率;

- 不会明显损害模型在指令遵循、数学、知识和情绪理解上的表现。

- 这意味着,未来模型安全不一定只靠 system prompt,也可能更多依赖对模型内部表征的直接干预。

最重要的信息提炼

- AI 对软件开发的影响非常不均衡:前端最先被深度重塑,研究和基础设施仍高度依赖人类专家。

- 长时自主执行能力成为大模型新战场:GLM-5.1 代表了“持续工作数小时”的竞争方向。

- 人形机器人开始进入真实工业生产:虽然规模不大,但已从试验迈向实际应用。

- AI 基础设施建设遭遇现实阻力:数据中心扩张的社会成本正引发更强烈的政治和社区反弹。

- 模型安全开始走向内部机制控制:稳定助手人格的研究,可能成为下一阶段对齐与防护的重要方向。

编辑备注

- 这期新闻的主线不是“又有新模型”,而是 AI 正在从模型能力竞争,走向真实世界中的组织、基础设施、硬件与治理竞争。

- 如果用于公众号/周报发布,这一期适合定一个总标题:

- 《AI 正在进入深水区:从长时智能体到数据中心冲突》

- 或 《本周 AI:模型更能干了,现实世界也更紧张了》