一句话概览

Starmorph 发布了一篇完整指南,拆解 Andrej Karpathy 近期提出的 “LLM Wiki” 模式:不是再造一个知识库产品,而是用大模型代理持续把原始资料编译成可读、可查、可维护的 Markdown 知识系统。

重点摘要

1. 知识库真正的瓶颈不是收集,而是维护

个人和团队知识库常常死在维护环节。收集资料很容易,初次整理也能靠热情完成,但持续归档、交叉引用、更新摘要、处理冲突,几乎没人能长期坚持。

Karpathy 的 LLM Wiki 思路,抓住的正是这个缺口:人负责挑选值得进入系统的资料和提出问题,LLM 负责生成摘要、补链接、更新索引、发现矛盾。它不只是让知识库“更好搜”,而是让知识库有机会长期保持可用。

这也是它和普通笔记工具、资料收藏工具最大的不同:真正被 AI 改变的不是记录动作,而是记录之后那一大段没人愿意做的整理工作。

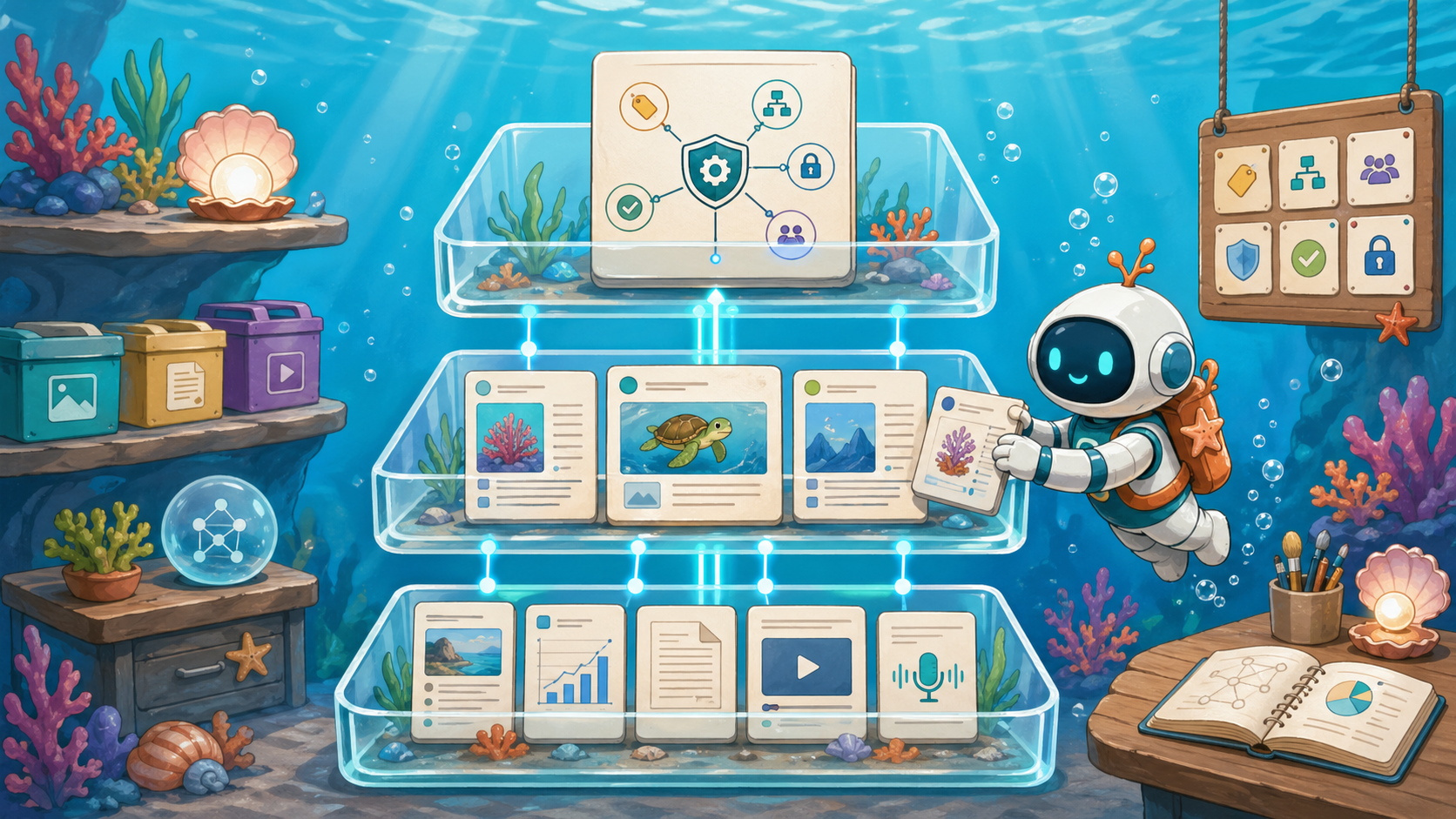

2. LLM Wiki 的核心是三层结构,而不是某个具体产品

Starmorph 将这个模式概括为三层:raw/ 保存不可变原始资料,wiki/ 保存 LLM 生成的 Markdown 页面,CLAUDE.md 定义结构、命名规范、页面模板和操作流程。

这套结构的价值在于,它把“来源”和“解释”分开了。raw/ 是事实基线,LLM 只能读取,不能随意改写;wiki/ 是可演化的理解层,可以被模型持续重组;CLAUDE.md 则像一份操作手册,约束模型如何生成、更新和审计内容。

虽然文件名来自 Claude Code 的实践,但这个思想并不绑定某个产品。只要一个 LLM agent 能访问文件系统、遵守 schema、留下变更记录,就可以采用类似的知识库组织方式。

3. 三个操作让知识库像软件一样运行:ingest、query、lint

文章把 LLM Wiki 的日常操作拆成三类:ingest 负责读取新资料并更新相关页面,query 负责根据索引和相关页面回答问题,lint 负责检查矛盾、孤立页面、缺失概念、陈旧观点和研究空白。

这里最有意思的是编译器类比:raw/ 像源代码,LLM 像编译器,wiki/ 像输出物,lint 像测试。每次新增资料都不只是生成一篇摘要,而是可能级联更新多个相关页面;每次查询也不只是检索片段,而是在已有结构上综合回答。

这让知识库从“文档堆”变成了“可运行系统”。它开始有入库流程、索引更新、质量巡检、变更日志、冲突提示和回滚机制,也更接近软件工程里的持续维护逻辑。

4. 它不是 RAG 的替代品,而是适合个人和团队规模的另一条路

Starmorph 将 LLM Wiki 和 RAG 做了对比:RAG 更适合百万级文档、复杂权限和高并发检索;LLM Wiki 更适合几十到几百份来源资料、需要可追溯、希望知识持续沉淀的个人或小团队场景。

这让 LLM Wiki 的定位更清晰。它不是“企业搜索平台”的低配版,而是一种以 Markdown、Git、索引和模型维护为核心的轻量知识编译模式。优势是低基础设施、强可读性、方便审计;限制则是规模、治理和模型反复改写可能带来的信息漂移。

对于研究、竞品分析、政策学习、技术专题跟踪这类中小规模但需要长期沉淀的场景,LLM Wiki 可能比传统 RAG 更贴近真实工作流:先选资料,再形成结构化理解,再让知识随时间复利。

最重要的信息提炼

这篇文章最值得关注的点,不是又出现了一个“第二大脑”玩法,而是知识库产品的设计范式正在变化:过去我们关注如何存得更多、搜得更快;LLM Wiki 关注如何让知识在进入系统后持续被整理、校验和更新。

从产品视角看,它给出了一套很实用的 AI 知识系统分层:

- 原始资料层:保留证据,不让模型随意改写。

- 生成知识层:允许模型综合、重组、建立链接。

- 规则治理层:用 schema、模板和工作流约束模型行为。

- 运维检查层:通过 lint、日志、Git diff 保持系统可信。

这比“上传文档然后聊天”更像一个可持续运营的知识产品。

产品经理视角

这篇文章对 AI 产品经理最大的提醒是:知识类产品的核心竞争力可能不再只是问答质量,而是知识生命周期管理能力。

一个更成熟的 AI 知识产品,至少要回答几个问题:

- 新资料进入系统后,如何被拆解、归档和关联?

- 旧结论被新资料推翻时,系统如何提醒用户?

- 每个答案能否追溯到原始来源,而不是只给出一段看似合理的综合?

- 模型更新知识时,是否有日志、diff、回滚和质量检查?

- 用户能否看懂哪些内容是原文事实,哪些是模型综合,哪些是低置信度判断?

这意味着,AI 知识工具不应该只做“更聪明的搜索框”。它们更像一套知识运维系统:人类负责判断什么值得进入系统,AI 负责把知识持续整理成可读、可查、可追溯、可更新的状态。

编辑备注

这篇 Starmorph 指南带有明显的开发者实践视角,但它对产品经理也很有参考价值。很多 AI 产品现在仍停留在“接入模型 + 向量库 + 聊天框”的组合,而 LLM Wiki 提醒我们:用户真正需要的可能不是一次性的答案,而是一个会随着新资料持续变好的知识工作台。

我的判断是,接下来一批实用型 AI 工具会从“对话入口”转向“知识维护代理”。它们不一定看起来很酷,但如果能稳定完成入库、更新、查证、巡检和输出,就会非常贴近研究、咨询、产品、投研、法务、医疗等知识密集场景。